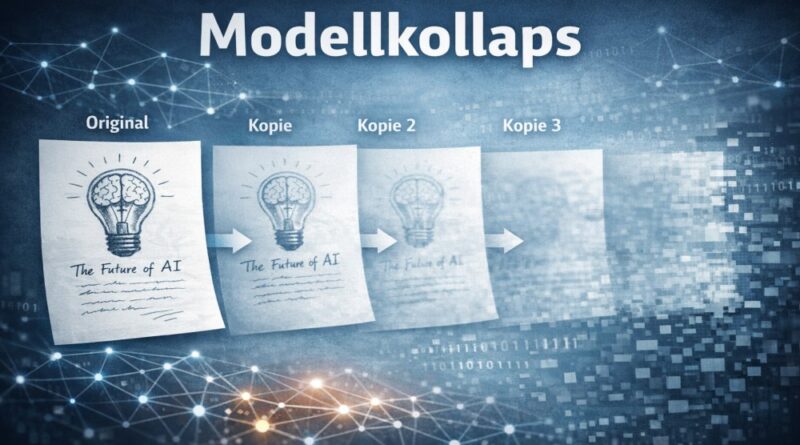

Modellkollaps: Werden KI-Systeme immer schlechter?

Seit Monaten häufen sich Hinweise auf ein Problem, das die Zukunft der Künstlichen Intelligenz grundlegend beeinflussen könnte: Modellkollaps. Gemeint ist die schleichende Verschlechterung von KI‑Systemen, wenn sie zunehmend mit Daten trainiert werden, die nicht mehr von Menschen stammen, sondern von anderen KI‑Modellen erzeugt wurden.

Was lange wie ein theoretisches Risiko klang, zeigt sich inzwischen in der Praxis. Forschende und Branchenbeobachter warnen: „Der Modellkollaps ist bereits Realität, und die Branche ignoriert ihn.“

Wie es dazu kommt: KI trainiert auf KI

Moderne Sprachmodelle lernen aus gigantischen Textmengen, die aus dem offenen Internet gesammelt werden. Doch das Internet verändert sich rasant:

- KI‑Tools erzeugen massenhaft Blogposts, Produktbeschreibungen, Social‑Media‑Beiträge und sogar ganze Nachrichtenportale.

- In manchen Bereichen wird bereits geschätzt, dass über 50 % neuer Inhalte maschinell generiert sind.

- Auch Bild‑, Audio‑ und Videomodelle speisen ihre Trainingsdaten zunehmend aus KI‑Material.

Damit entsteht eine Rückkopplungsschleife: Neue Modelle trainieren auf Daten, die von alten Modellen stammen.

Das Ergebnis ähnelt einer Fotokopie einer Fotokopie: Mit jeder Generation geht etwas verloren.

Was genau verschlechtert sich?

Die Veränderungen sind subtil, aber messbar:

- Verlust seltener Ausdrucksformen: Modelle verlieren die Fähigkeit, ungewöhnliche, kreative oder randständige Sprachmuster korrekt wiederzugeben.

- Verengter Wortschatz: Die Vielfalt nimmt ab, Antworten ähneln sich stärker.

- Statistische Verzerrungen: Häufige Muster werden überbetont, seltene Muster verschwinden.

- Homogenisierung: Texte klingen glatt, aber austauschbar – „selbstsichere Mittelmäßigkeit“.

Studien – etwa von der Rice University – zeigen, dass Modelle bereits nach wenigen Trainingsgenerationen mit synthetischen Daten deutlich an Leistungsfähigkeit verlieren. Seltene Informationen verschwinden zuerst.

Warum das ein systemisches Problem ist

Der Kern des Problems ist nicht technischer, sondern wirtschaftlicher Natur:

- Hochwertige, menschlich erstellte Daten sind teuer.

- Der Druck, schnell neue Modelle zu veröffentlichen, ist enorm.

- Synthetische Inhalte sind billig und überall verfügbar.

Viele Unternehmen greifen daher auf das zurück, was leicht zugänglich ist – und das ist zunehmend KI‑Material.

Gleichzeitig wird es immer schwieriger, KI‑Texte zuverlässig von menschlichen Texten zu unterscheiden. Filter existieren, aber sie sind unvollkommen und werden mit jedem Fortschritt der Modelle unzuverlässiger.

Nicht nur Text: Auch Bilder, Audio und Video sind betroffen

Bildgeneratoren wie Midjourney, DALL‑E oder Stable Diffusion produzieren täglich Millionen synthetischer Bilder. Diese landen auf Stockfoto‑Plattformen, in Blogs, in Shops und in sozialen Netzwerken.

Die nächste Generation von Bildmodellen trainiert also auf einem Datenmix, der bereits stark künstlich geprägt ist. Das gleiche Muster zeigt sich bei Musik, Stimmen und Videos.

Mögliche Lösungswege – und ihre Grenzen

Die Forschung und einige Unternehmen arbeiten an Gegenmaßnahmen. Doch keine davon ist einfach:

1. Transparenz über Trainingsdaten

Offenlegung, wie viel synthetisches Material in Datensätzen steckt. Bisher tun das nur wenige Unternehmen.

2. Investitionen in Datenkuratierung

- Bezahlte Partnerschaften mit Verlagen

- Lizenzierung hochwertiger Inhalte

- Aufbau geprüfter, menschlicher Datensätze

Das ist teuer – aber notwendig.

3. Technische Schutzmaßnahmen

- Bessere Erkennung synthetischer Inhalte

- Robustere Trainingsmethoden

- Wasserzeichen für KI‑Inhalte (bisher leicht zu entfernen)

4. Regulierung

Der EU‑AI‑Act adressiert Transparenz, aber nicht explizit den Modellkollaps. Zukünftige Regeln könnten Qualitätsstandards für Trainingsdaten verlangen.

5. Bewahrung „prä‑KI‑reiner“ Datensätze

Archive menschlicher Inhalte von vor 2022/23. Nützlich – aber begrenzt und nicht aktuell.

Warum das Thema kulturell relevant ist

Wenn KI‑Modelle ihre Fähigkeit verlieren, die Vielfalt menschlicher Sprache und Kreativität abzubilden, geht mehr verloren als technische Präzision.

Es geht um kulturelle Vielfalt, um Ausdrucksformen, um Denkweisen. Eine KI, die nur noch Mittelmaß reproduziert, spiegelt nicht mehr die Breite menschlicher Erfahrung wider.

Ausblickt: Die Zeit läuft

Der Anteil synthetischer Inhalte im Netz steigt Monat für Monat. Je länger die Branche wartet, desto schwieriger wird es, die Datenqualität wiederherzustellen.

„Die Maschinen zerstören sich selbst. Die Frage ist, ob irgendjemand handelt, bevor der Schaden irreparabel wird.“

Der Modellkollaps ist kein Science‑Fiction‑Szenario. Er ist ein reales, wachsendes Risiko – und er betrifft die Grundlage aller zukünftigen KI‑Entwicklung.